iPhoneのカメラが大きく進化するかも、米Appleが買収したLinXの技術から考える

米AppleがイスラエルのLinX Computational Imagingを買収したと米Wall Street Journalが4月14日(米国時間)に報じた。同紙が関係者の話として伝えるところによれば、買収金額は2,000万ドル程度が提案されていたようだ。現在LinXのWebサイトは半分壊れた状態で詳しい情報はほとんど残っていないが、WSJによれば、同社はスマートフォンやタブレット向けに複数の小型カメラセンサーを用いて3D映像の取得が可能な仕組みを開発しているという。これが具体的にどのような技術で、買収後のAppleからどのような製品が出てくる可能性があるのかを考えてみる。

○LinXのカメラ技術でどういったことが可能になる?

現在LinXのサイトそのものには記載されていないようだが、BusinessWireには同社が昨年2014年6月に配信したプレスリリースが残っており、これで製品や技術の概要を知ることができる。

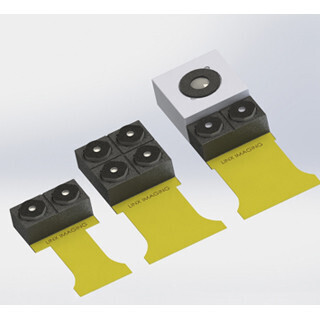

リリースにも記載されているが、昨今のスマートフォンやタブレット向けカメラはイメージセンサーの高解像度化や高級化路線が一段落し、新たな差別化ポイントを模索する段階に入りつつある。画質もさることながら、既存のイメージセンサーと有り余るプロセッサパワーを使って、いかに画像にさまざまな後処理を施すかという部分に力が注がれている。そこで登場したのがLinXの「アレイ(Array)カメラ」であり、1つではなく複数のイメージセンサーを組み合わせて一度に複数の画像情報を取得することで、従来のカメラにはないさまざまな仕掛けを可能にする。

具体的には、複数のイメージセンサーを用いることにより撮影対象のかなり正確な"深度"情報の取得が可能になり、映像のピクセル間に存在する距離を認識して空間マッピングが可能になる。この情報を利用すれば、例えば撮影画像のオブジェクト間の距離やサイズが正確にわかるようになるほか、手前のオブジェクト(人物など)のみを抽出して別の背景と合成したり、あるいはフォーカスをかける対象を撮影後に変更したりと、従来のカメラ撮影では難しかった加工が容易になる。

またイメージセンサーの数が増えることで、暗所撮影などで問題になるノイズ除去の精度が上がったり、スマートフォンに搭載される小型のカメラモジュールでデジタル一眼レフに近い画質の再現が可能であったりと、カメラそのものの性能が向上するというメリットがある。イメージセンサーから得られる情報が増えることで、おそらくは従来のHDRで不自然だった合成処理も、より自然なものに仕上がるという効果も期待できるだろう。

●iPhoneに3Dカメラが搭載!?

○搭載の進む3Dカメラ技術、以前に買収したPrimeSenseとの違い

深度情報を得て空間把握が可能な「3Dカメラ」がコンシューマの世界に入ってきたのは比較的最近のことだ。最もメジャーなものは「3Dモーションセンサー」として人体の動きでゲーム機へのUI入力が可能な「Kinect for Xbox 360」で、Microsoftから2010年に発売された。Kinect for Xbox 360では現在Apple傘下にあるイスラエルのPrimeSenseが開発した技術が用いられている。現在のMicrosoft Kinectでは別の技術が用いられているが、PrimeSenseの技術では赤外線(InfraRed)照射装置とそれを受光する"深度センサー"、そして通常の周辺画像を取得するイメージセンサーとマイクを組み合わせることで、音声コマンドと人体モーションによるゲーム機の操作を可能としていた。

3Dカメラの実現方式はさまざまなメーカーや研究所によって開発され数多存在するが、そのうちの多くはPrimeSenseが用いている「赤外線(IR)」+「深度センサー」の組み合わせというケースが多い。昨年末に対応製品(Dell Venue 8 7000 Series)が登場して話題になったIntelの「RealSense」もまた、このIR+深度センサーを用いた方式で、先ほど紹介したLinXが実現できる距離計測や後加工といった仕組みを実装している。

Intelは2015 International CESにおいて、このRealSenseカメラを用いて3Dオブジェクトを"スキャン"し、3Dプリンタでこのスキャンしたオブジェクトを出力するデモを行っている。RealSense技術を採用したスマートフォンやタブレットを手に、3D印刷したいオブジェクトの周囲をまわることでその形状や表面の色(質感)データの取得が可能になるが、これは加速度センサーなどを組み合わせることで撮影画像をリアルタイムで合成し、ソフトウェアでモデリングデータを自動生成することで実現している。

そしてIRを用いない方式の3Dカメラとしては、今回のLinXやPelican Imagingの技術が挙げられる。IR方式の3Dカメラにはいくつか弱点があり、まず屋外のような光の強い場所では測定誤差が大きいこと、そして赤外線照射距離の問題で数メートル~数十メートル程度の距離のオブジェクトの深度しか測れない。照射距離や時間を増やせば対応可能だが、モバイル端末ではバッテリ消費やモジュールサイズの問題もあり難しい。

一方でLinXやPelicanが採用する方式は「複数の格子(Array)状のイメージセンサーを組み合わせて画像を同時撮影」する手法で3Dカメラの「深度情報取得」を実現しており、IRにまつわる問題を解決できるほか、屋内外のどちらでも比較的高品質な画像を取得可能になっている。

●3DカメラはいつiPhoneに搭載されるか

アレイカメラ方式の弱点としては、カメラモジュールのコストが高くなることが1点挙げられる。現在スマートフォンやタブレットに搭載されているイメージセンサーはハイエンドのものでも単価は10ドル未満であり、これとレンズやLEDフラッシュと組み合わせて搭載したとしても、製品全体のBOM (Bill Of Material)に占める割合はそれほど大きくない。現在タブレットへの採用が少しずつ進みつつあるRealSenseでも若干割高ではあるものの、それほどコストに大きなインパクトを与えるものではないと考えられる。

ただし筆者が聞くところ、Pelicanのような専用カメラモジュールの場合はこれらに比べ2~3倍程度のコストを要するとのことで、これほどではないとしても、LinXの技術の採用はコスト上昇要因の1つとなるかもしれない。

アレイカメラ方式のもう1つの問題として、処理加工のためにプロセッサパワーを非常に多く消費するという特徴が挙げられる。写真1枚撮影するだけで大量のデータが取得され、これを一度に処理しないといけないため、特にGPUに大きな負荷をかける。前出Pelicanのケースでは、デモ機に用いていたSnapdragon 805ではすでに重い状態で、商用化にはこれより1~2世代後のプロセッサが必要だと感じたレベルだった。おそらく現行で市場に存在するハイエンドのスマートフォンでも重い処理で、LinXにおいても同種の制限が存在するとすれば、実際にApple製品に搭載されるのは早くて2016年か2017年以降となると予想する。

○AppleはLinXの技術をどのように製品に組み込むか

現時点で買収済みのPrimeSenseの技術を採用した製品が市場投入されていない状態だが、Appleは近い将来にLinXの技術を採用した製品を市場投入してくることだろう。PrimeSenseはモバイル端末というよりもむしろ、デスクトップ環境やリビングルームでの「3Dモーションセンシング」に活用してくると考えられ、例えば今年後半にもAppleによる製品投入が噂されている「新型Apple TV」のUIに採用される可能性もゼロではない。

前出のように、パフォーマンス的理由やBOMに与えるコストインパクトから、LinXの技術をiPhoneやiPadといったiOSデバイスに搭載してくるのは早くて来年2016年以降とみられる。AppleがLinXをiOSデバイスに採用する大きなメリットの1つが「カメラモジュールの薄型化」にある。LinXによれば、画質を上げるためにイメージセンサーのサイズを大きくするとレンズの厚みが増える問題が出てくる。ところが、同社の技術のように大型イメージセンサーを複数の小型のイメージセンサーの組み合わせで置き換えることで、このレンズ部分の薄型化が可能になり、カメラモジュール全体の薄型化を実現できるという。

iPhone 6をよく利用するユーザーならご存じだと思うが、同製品は本体薄型化の弊害として「レンズ部分が飛び出ている」という、非常にデザインとしては"いただけない"ものになっている。英ロンドンでハイエンドスマートフォンの新製品「P8」を発表した中国のHuaweiは、「iPhone 6のようにレンズが飛び出していない」という点をセールスポイントに製品をアピールしていたりと、すでに多くがネタに使うようなデザイン上のウィークポイントだ。

ゆえにLinXの採用はiPhoneのさらなる薄型化を実現する可能性も秘めており、さらに「カメラの新しい使い方の提案」も可能にするなど、大きな差別化ポイントとして機能するとみられる。いずれにせよ、非常に楽しみな動きだ。